"כשהקונגרס יצר את ה-UCR (Uniform Crime Reporting) בשנות השלושים הוא עשה את זה התנדבותי לחלוטין", מספר לי פיטר הארגרוב שהקים את מאגר הנתונים המקיף ביותר של מקרי רצח בארה"ב. "מדינות שלמות לא חייבות לדווח, ומי שלא נעתרה לבקשות שלנו מתוקף חופש המידע, לקחנו לבית המשפט וחייבנו אותה". היום במאגר הנתונים של "פרויקט האחריות לרצח" (Murder Accountability Project) יש 750 אלף מקרי רצח מתועדים ומפורטים עוד החל משנות השישים, ללא ספק התיעוד המלא והנגיש ביותר בארה"ב.

אבל הארגרוב (Hargrove) לא עצר שם ופיתח אלגוריתם שמצליח, לכאורה, להציף קשרים בין מקרי רצח שעד אז נראו בודדים ולא קשורים. "שוטרים משתמשים במד הנתונים שיצרנו ובאלגוריתם שבנינו כדי לבחון תיאוריות שונות", הוא מספר ומוסיף "המערכת עוזרת להם לחבר נקודות שהם בכלל לא ידעו שקיימות". לא סתם מכנה הארגרוב את האלגוריתם שלו "גלאי רוצחים סדרתיים". הארגרוב אינו זאב בודד, אלא חלק מטרנד גיוס טכנולוגיה ואינטליגנציה מלאכותית לשורות המשטרה.

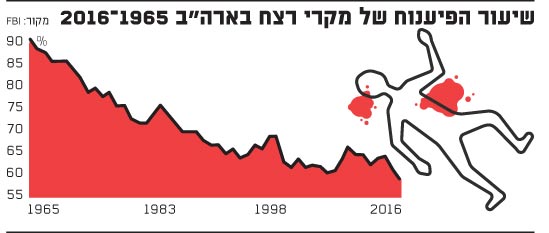

בכל שנה יש כ-5,000 מקרי רצח לא פתורים בארה"ב - קצת יותר מ-59%, שיעורי הצלחה שלטענתו הם מהנמוכים בעולם המערבי. "ליצור את האלגוריתם זאת שאלה של הצלת חיים. חלק מהרוצחים האלו שמסתובבים חופשי בוודאי רוצחים שוב והם גם מייצרים אווירה ציבורית שניתן לבצע פשעים חמורים ולא להיתפס". גישה זו הביאה את הארגרוב להעריך כי היום מסתובבים כ-2,000 רוצחים סדרתיים ברחבי ארה"ב, נתון מבהיל לעומת הערכות ה-FBI שעומדות על אחוז בודד מכלל הרציחות. העובדה כי מאחוריו בסיס הנתונים הגדול ביותר במדינה הפכה את ההערכה שלו לאמינה במיוחד ואותו למומחה מבוקש ומצוטט במגזינים כמו הניו יורקר, בלומברג והאטלנטיק.

הקוד של הארגרוב, ששימש ככתב פלילי בעברו, אוסף נתונים ממקרי רצח שונים אך שחולקים מאפיינים כמו מתודה, מקום, זמן, מין הנרצח ושיעור מקרי הרצח הפתורים באזור. הארגרוב מקווה כי הפתיחות שבה מנוהל הפרויקט יהיה בעל השלכות פוליטיות. "השקיפות הגדולה יכולה לעודד פוליטיקאים לדרוש תשובות, לדחוק בכוחות המשטרה לפעול בצורה יעילה יותר כדי להביא לפתרון פשעים". Murder Accountability Project הוא פרויקט ללא מטרות רווח וכל הלוקחים בו חלק עושים זאת בהתנדבות ומתוך תחושת מחויבות, אך קיימות חברות פרטיות רבות למטרות רווח שלוקחות חלק פעיל בפתרון תעלומות משטרתיות. סטארט-אפים רבים מציעים פתרונות אינטליגנטים וממוחשבים להקל או להחליף את עבודת המשטרה. בין אם מערכות AI לזיהוי פלילי דיגיטלי (כלים לניתוח מחשבים, רשתות ומכשירים סלולריים) או כדי לאתר ילדים נעדרים וקורבנות של סחר בבני אדם. מערכות שונות פרטיות אלו כבר בשימוש על ידי כוחות השיטור המקומי והפדרלי בארה"ב.

אולי הגדולה ביותר בתחום היא אקסון. אתם אולי תכירו אותו בשמה הקודם טייזר - השם הנרדף לשוקר חשמלי. באפריל השנה טייזר עשתה מייקאובר כללי: היא שינתה את שמה לאחד עם ניחוח יותר עתידני ואת הגדרתה מיצרנית נשקים חשמליים לחברת טכנולוגיה, מפגש בין "מלחמת הכוכבים, ג'יימס בונד ומסע בן כוכבים", כהגדרתה. באותו אפריל אקסון יצרה מהומה לא קנה כשהכריזה שתעניק את מצלמות הגוף בפיתוחה לכל שוטר בארה"ב, בחינם. ממש כאילו עם שינוי השם גם הפכה להיות חברת הזנק. לא רק זאת, היא גם הודיעה שתישא על עצמה את עלויות ההדרכה, התפעול ואחסון המידע לשנה אחת. לפי דיווחי החברה כבר 6,000 סוכנויות משטרה שונות מחוברות לפלטפורמה שלה.

מה אקסון מרוויחה מכל זה? ובכן כמובן שמידע. טרה בייטים על גבי טרה בייטים של מידע על השרת הפרטי של החברה Evidence.com. "מדובר על אחד ממאגרי המידע העשירים ביותר", ציין מנכ"ל אקסון ריק סמית בראיון למגזין PoliceOne. את המידע הזה אקסון מגייסת לעבודה, היום החברה מציעה שירותי AI בתשלום לפענח את כל המידע הזה. הנה כבר באוקטובר האחרון החלה אקסון בשיתוף פעולה (כלכלי) עם משטרת לוס אנג'לס בפרויקט הבינה המלאכותית שלה בעל השם המתוחכם Axon AI, שבו התוכנה של אקסון תסייע למשטרת לוס אנג'לס לנתח את הצילומים שנאספו על ידי מצלמות הגוף. "בשנה האחרונה", ציינו במשטרה המקומית בהודעה משותפת עם אקסון, "נאספו צילומי וידאו באורך 33 שנה. המערכת של אקסון תחסוך בכוח-האדם ותסייע לפענח את המידע הרלוונטי ממנו". המערכת של אקסון מתורגלת לעבור על המידע שעולה על שרתיה וממנו היא אמורה לשלוף את כל מה שהיא מגדירה כרלוונטי, היא לכאורה מזהה בהליך אובייקטיבי את הרגעים המהותיים שנקלטו, מאתרת חשודים באמצעות תוכנות זיהוי פנים, מאתרת חשודים ועדים.

מנסים להגן מפני טעויות אנוש

באירופה כמו באירופה המצב הרבה יותר מפוקח. מי שמוביל את ההתקדמות הטכנולוגית ושילובה בכוחות השיטור היא דווקא הנציבות האירופית שמשקיעה היום בפרויקטים שונים שמובילים צוותי מדענים באוניברסיטאות ומכוני מחקר שונים. הפרויקט הגדול והמתקדם מבניהם הוא VALCRI (Visual Analytics for Sense-Making in Criminal Intelligence Analysis) שמטרתו לנתח באופן אוטומטי - אך יצירתי - נתונים ממגוון רחב של מקורות ולהציע הסברים אפשריים לפשעים.

המערכת אמורה לכאורה להציע במהירות טיעונים מדויקים, מוגנים מפני טעויות אנושיות ומבוססת - כך לפי אתר הפרויקט - על "אינטליגנציה אובייקטיבית" (מה שזה לא יהיה). ב-VALCRI בהובלתו של פרופסור וויליאם וונג (Wong) מבית הספר למדע וטכנולוגיה באוניברסיטת לונדון מצטטים דו"ח חקירה ממלכתי על פיגועי ה-11 בספטמבר שהכישלון הגדול ביותר של הרשויות היה "חוסר דמיון", חסך שלא חסר לפושעים או טרוריסטים. ב-VALCRI טוענים כי דווקא מערכות ממוחשבות, אותן מכונות יצירת אדם, יכולות להציע כיוונים יצירתיים שנסתרת מאנליסטים מיומנים של כוחות המשטרה. "כולם חושבים שלחבר את הנקודות זה החלק הקשה", מציין פרופסור וונג. "זה למעשה החלק הקל. החלק הקשה הוא להבין אילו נקודות צריך לחבר".

המערכת של VALCRI מצליחה לחבר בין הנקודות לכאורה רלוונטיות בלחיצת כפתור אחת, פעולה שלוקחת בממוצע 73 חיפושים בודדים של אנליסט. VALCRI עושה זאת באמצעות יכולת קריאה, הבנה וניתוח דו"חות משטרתיים והפעלת תוכנות לזיהוי פנים כדי לחפש את המבצעים מתוך אלפי שעות וידאו. גם אם אלו נכתבו על ידי אנשים שונים, בהערות צד או באמצעות תיאורים לא עקביים. בסופו של ניתוח המערכת אף מציעה שחזור ויזואלי של אותן השערות, היא למשל מקבצת את הנתונים במגוון רחב של נקודות השקה שחוצות סוגי עבירות, מדינות ואף אם נתפס או לא המבצע ומייצרת מפות שונות של אירועים. בתחנות משטרה באנגליה ובלגיה כבר מנסים בפועל את המערכות שמצוידות בנתונים אמתיים שלוש שנים אחורה.

זה לא פרויקט השיטור היחידי שממומן על ידי הנציבות האירופית. P-React נוצר לאחר המשבר הכלכלי העולמי ועם העלייה בפשעים קטנים (Petty crimes) כמו ריסוס גרפיטי או חטיפת תיק מהולך רגל, מה שמכונה על ידי הנציבות "התנהגות אנטי-חברתית". הרעיון מאחורי החברה פשוט: יצירת פלטפורמת מעקב אינטליגנטית בעלות נמוכה שצפויות לפזר הרשויות המקומיות בשטחים ציבוריים ויכולים אזרחים ובעלי עסק בשטחים הפרטיים שלהם. כל אלו יהיו מחוברים בענן למערכת שתנתח ותודיע כשפשע מתרחש. נכון להיום הפרויקט הסתיים ולפי הנציבות בהצלחה מסחררת, והוא מחכה לרשות הראשונה שתרים את הכפפה ותיישם אותו בשטחה. בנציבות מאמינים שבשל העלויות הנמוכות של המערכת יום זה אינו רחוק, אם כי גלגלי פרויקטים ציבוריים ידועים לשמצה בתנועתם האיטית.

אנשים תמימים שלובשים קפוצ'ון

מצלמת גוף של אקסון היתה מוצמדת לחולצתו של ריצ'רד פניהיירו ביום שבו ביצע מעצר סמים בבולטימור. המצלמות היו עניין חדש במשטרה, חלק מפיילוט רחב ופיהיירו ללא ספק לא שלט בתפעולה.

המצלמה תיעדה את השוטר הצעיר שותל שקית כדורים בסמטה מלאת אשפה, ולאחר כמה רגעים שב לאותו המקום וחושף בפעילות משטרתית מתוחכמת את אותם הכדורים שהחביא. "יו", הוא נשמע מציין בפליאה. פנהיירו שניסה להפליל מי שחשד בו כסוחר סמים, לא ידע שמצלמת הגוף צילמה אותו משתיל את הסמים. לצערו, עורכי הדין של העצור ראו את הווידאו והמעצר בוטל כלא היה, כמו גם הקריירה שלו.

מאז שנחשף המקרה הזה ביולי השנה, צצו להם מקרים דומים נוספים ובולטימור סיימה את פיילוט מצלמות הגוף שלה. איסוף המידע במקרים אלו הגן על אזרחים שונים מפני שימוש לרעה של כוחות המשטרה. אך אלו היו עיניים אנושיות שעברו על מאות שעות תצלומים ושהיו מספיק מורכבות כדי לנתח מידע במגוון כיוונים, לא רק כזה שמחפש אזרחים עבריינים. אך כשמערכות בינה מלאכותית ולמידה עמוקה מופעלות ככלי שלכאורה מתגבר על חולשות אנושיות הוא מייצר מראית עין של אובייקטיביות.

למידה עמוקה היא פעולה שבה מחשב מאומן "לדעת" דברים על בסיס ניסיון. הניסיון הזה מוגש לו בתבניות על תבניות עמוסות במידע. כל מפגש עם תבנית חדשה מחזק אצל המערכת הממוחשבת את התפיסות שלה לגבי מה נכון או לא, באמצעות נתונים שמאמתים או מחלישים את התפיסות שלהן. זו פעולה שבבסיס היא ההפך הגמור מאובייקטיביות. כך למשל אם מערכת כזו תיחשף לאלפי תצלומים של עבריינים בורחים מזירת פשע, היא עלולה ללמוד גם - שלא במתכוון - להיות מוטה נגד אנשים תמימים שפשוט אוהבים להסתובב לבושים בקפוצ'ונים או כובעי צמר. זאת משום שהמערכת אינה "מבינה" מיהו אדם הנמלט מזירת פשע, היא פשוט "יודעת" כשהיא רואה אותו.

הניסיון כבר לימד שמי שמזין את המידע למערכות ממוחשבות אינטליגנטיות הם אנשים מלאי הטיות חברתיות ותרבותיות.

הטיות שהובילו למקרים מצערים כמו מערכת התיוג של גוגל שמזהה אנשים שחורים כגורילות או הצ'אט בוט המכונה Tay של מיקרוסופט שהפך בתוך יום למפלצת גזענית משתוללת. אלו דוגמאות מעליבות, אך ללא השלכות מהותיות על חירויות אזרחיות. תוכנות שעושות עבודה משטרתית במשרד האחורי יכולות להיות ספוגות בהטיות מבניות ולהצביע על נטיות פרטיות. קידוד הטיות אלו מייצר הילה של אובייקטיביות של מכונות ומחליש את הביקורת נגד התוצאות המופקות. כל חיבורי הנקודות היצירתיים עלולים להיות בסופו של דבר בעוכרם של החלשים ולכן צריכים שקופים וציבוריים להיות מפוקחים על ידי הספקנות האנושית.

שיעור הפענוח של מקרי רצח בארהב

לתשומת לבכם: מערכת גלובס חותרת לשיח מגוון, ענייני ומכבד בהתאם ל

קוד האתי

המופיע

בדו"ח האמון

לפיו אנו פועלים. ביטויי אלימות, גזענות, הסתה או כל שיח בלתי הולם אחר מסוננים בצורה

אוטומטית ולא יפורסמו באתר.